负责任AI 让学术写作更有底气

旨在助您在学术论文写作过程中,以规范、透明且符合科研伦理的方式,明智应用生成式人工智能

论文写作中,您是否已考量这五个关键问题?

01我可以在论文写作中使用生成式AI吗?

02在何处使用、以及如何使用AI才最合适?

03作为论文作者,我需要承担哪些责任?

04我的AI使用方式是否符合出版机构的指南?

05我的稿件是否需要人工复核?

作为论文作者,您需要承担哪些责任?

01人工审核

不可或缺

无论生成式AI的参与程度如何,投稿前每篇文章都必须经过人工深度审校。审校者应该兼具学科背景与语言能力,以确保AI的介入没有偏离科研原意,更没有改变研究的本质。

02使用记录

与规范披露

在撰写过程中,请养成记录AI使用痕迹的习惯。建议保存您与AI辅助工具的对话记录,明确标注其应用环节与用途。这样您才能在声明中清晰、准确地披露AI的使用程度,确保学术诚信。

03数据安全

与隐私保护

请务必警惕:生成式AI可能会利用您的数据进行自我训练。您上传的任何内容都可能被存储、记录甚至抓取。请确保在安全的环境下使用AI,且严禁将涉及科研机密或未发表的核心数据上传至非受控平台。

出版机构对作者有何期待?

出版机构希望作者能以负责任的方式应用AI,明确披露生成式AI的使用场景与程度,并确保所有内容在投稿前均经过了人工严密审核。为了助您从容应对这些合规要求,我们构建了一个面向科研人员免费开放的科研工具库。

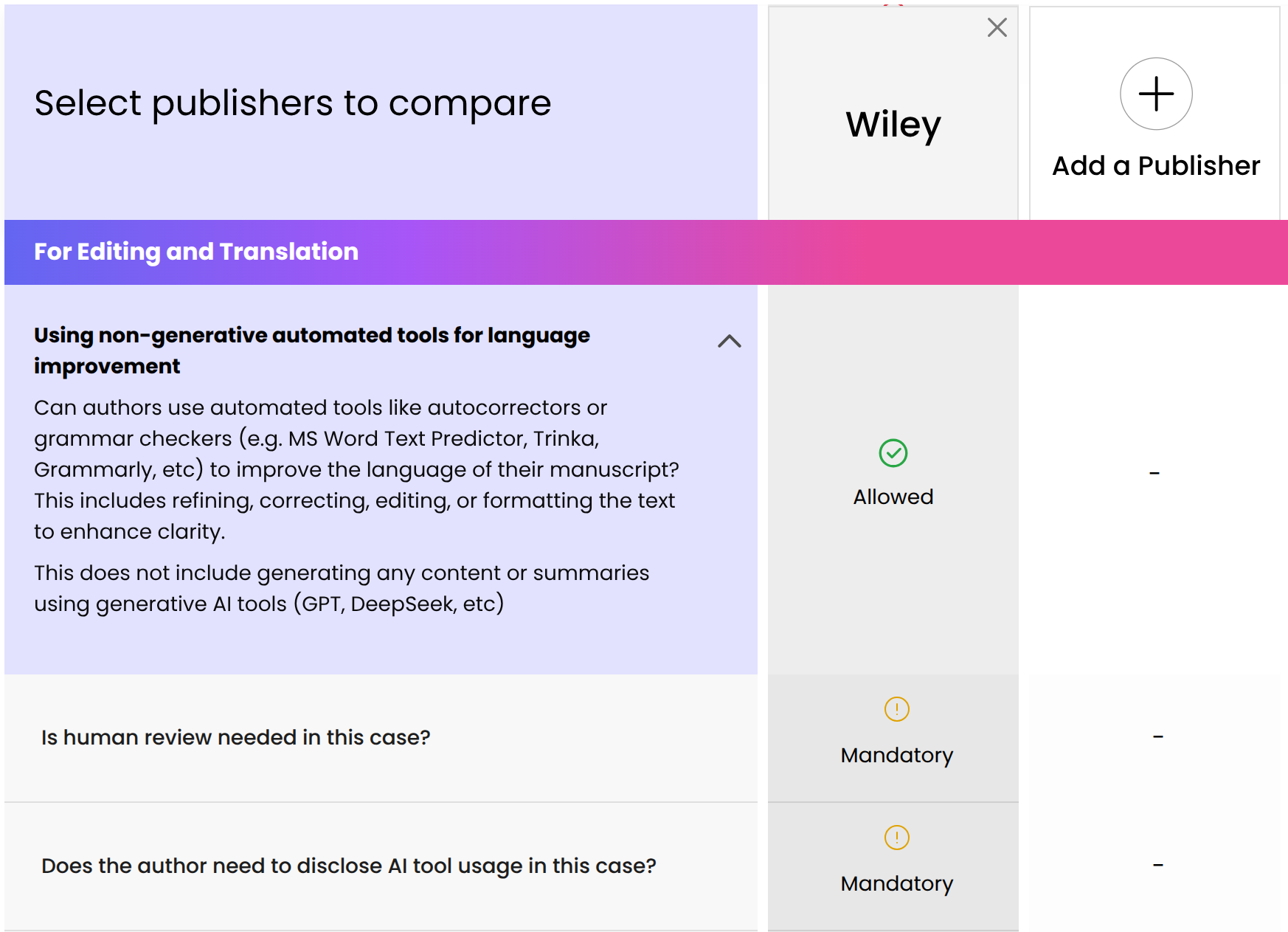

01紧跟出版机构合规政策

全球各大出版机构均已发布AI使用准则。然而,将这些复杂的条文转化为具体的行动要点往往费时费力。

通过我们免费提供的出版机构政策指南,您可以轻松查阅全球前20大出版机构的政策核心,所有逻辑分类一目了然。

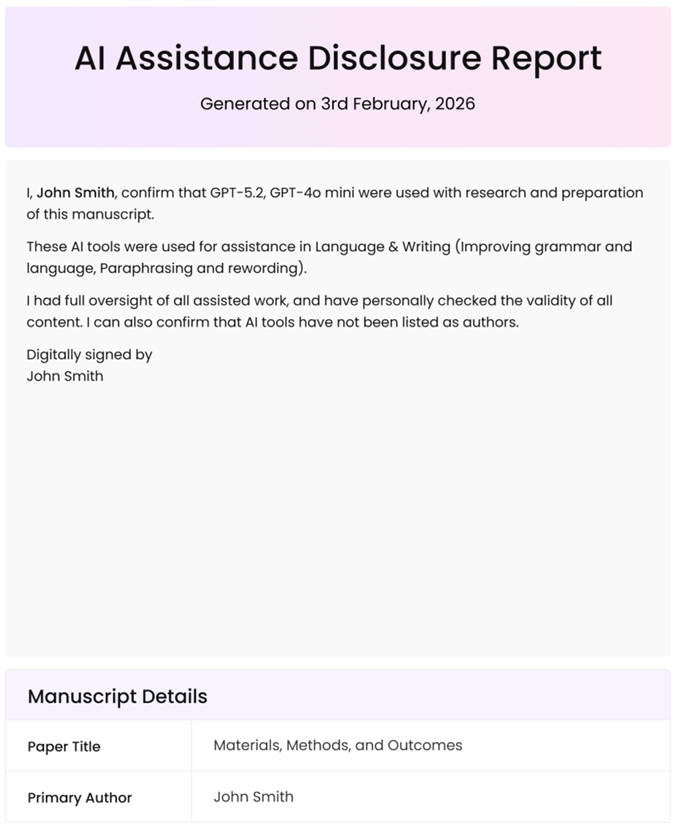

02完善AI使用声明与披露

出版机构要求作者提交《披露声明》,详细说明在何处、因何目的以及在多大程度上寻求了ChatGPT、Claude、Gemini等生成式AI工具的帮助。

利用这份免费模板,您可以按照出版机构的要求,精准、规范地完成每一项合规披露。

03强化人工复核与把关

全球主流出版机构在AI指南中均强调:作者对稿件内容负有最终责任。这意味着,无论AI参与程度如何,提交前的深度人工复核都是确保合规的关键。

简而言之,为避免AI可能产生的逻辑漏洞或学术误导,稿件需经由具备资质的专业人士——如同行专家或专业机构——进行严谨预审,以确保研究的原创价值与科研深度不受损。

这种结合了学科视角与语言水准的双重把关,将为您投稿的安全性提供坚实保障。

负责任AI工作坊

我们面向高校及科研机构开展专题工作坊,分享生成式AI的规范应用与实操技巧,助科研人员在AI时代守住学术底线。

为您的机构预约工作坊

010-62131959

010-62131959 添加人工客服

添加人工客服

QQ:2502411806

QQ:2502411806 一分钟快速报价

一分钟快速报价