统一AI使用指南势在必行,学术写作正全面拥抱生成式工具

随着ChatGPT等生成式人工智能(AI)工具加速发展,它们在各个领域的应用日益广泛,学术出版也不例外。这类工具在优化科研写作流程方面展现出巨大潜力,但也带来了亟需认真审视的挑战。

CANGARU倡议

强大的生成式AI工具(如ChatGPT)被纳入学术写作后,引发了关于潜在滥用的担忧,并催生了对统一使用规范的迫切需求。为应对这一问题,全球倡议项目CANGARU汇聚了来自各学科的4000多名研究人员,以及Elsevier、Springer Nature、Wiley等大型出版机构与出版伦理委员会(COPE)等行业组织。该倡议计划在今年8月前制定一套基于共识的统一标准,明确AI的合规用途、披露义务与禁止行为,以维护科研诚信。

英论阁学术院的一项调查显示,65.95%的受访者支持制定一套通用的科研伦理指南,这表明在AI时代,学术界倾向于采取更全面系统的伦理规范。

对建立明确标准的紧迫性,可以从近期的估算中看出:据称,2023年发表的论文中已有1%至5%包含AI生成内容。CANGARU项目负责人Giovanni Cacciamani指出,这项“快速演变”的技术需要对拟定的指南进行年度更新。

制定统一指南的必要性

许多高影响力期刊(如《Science》和《Nature》)以及其他组织已制定关于AI工具在学术写作中使用的相关政策。这些政策指出,AI工具不能作为作者署名,因为它们无法承担责任。同时,作者必须披露AI使用的具体方式和范围,但各组织的具体指南差异较大。

科学组织间的显著分歧体现在STM协会和欧盟委员会的做法上。STM协会在2023年12月发布的政策中,界定了生成式AI的可接受用途,但其他使用规定则由期刊编辑按具体情况决定。相比之下,欧盟委员会最近的公告较为简略,强调工具使用过程的透明性,以及研究人员对其科研成果的最终责任。

指南之间的差异造成研究人员的困惑。将各方政策整合为统一标准,将有助于提供清晰的一致性,确保科研成果在透明性、责任性和合规性方面达到统一要求。

制定明确的指导方针至关重要,但其真正的成功依赖于出版机构的广泛采纳,以及包括科研机构、资助方与学术委员会在内的强有力的执行机制。

英论阁学术院为评估AI在学术出版与科研伦理中所扮演的角色与影响开展的调查表明,学界在信任AI生成内容方面持多元观点,这些分歧受以下因素影响:透明度不足、偏见风险、伦理顾虑、可靠性问题、

文化差异,以及认知水平和教育程度不一等。

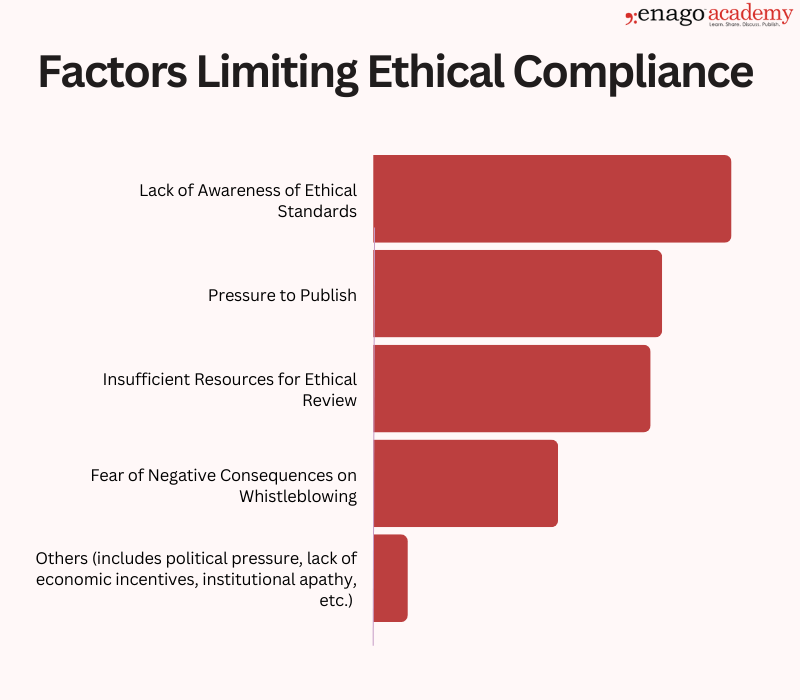

此外,限制伦理合规性的最主要因素是“缺乏对伦理标准的认知”(30.83%的受访者选择),这表明学术界亟需通过系统化培训项目提升对伦理规范的认知,确保科研人员能正确理解和遵守相关标准。

我们需要承认并鼓励一种协同合作的方式,让AI成为人类智慧的有益补充。同时,也必须优先推动教育与培训,让个体具备与AI高效协作所需的技能。

维护科研诚信,需要采取能够跟上生成式AI技术迅猛发展的主动策略。

010-62131959

010-62131959 添加人工客服

添加人工客服

QQ:2502411806

QQ:2502411806 一分钟快速报价

一分钟快速报价